SUBJECT: Szkolenia AI prawo i unijny AI Act - co musi wiedzieć zespół

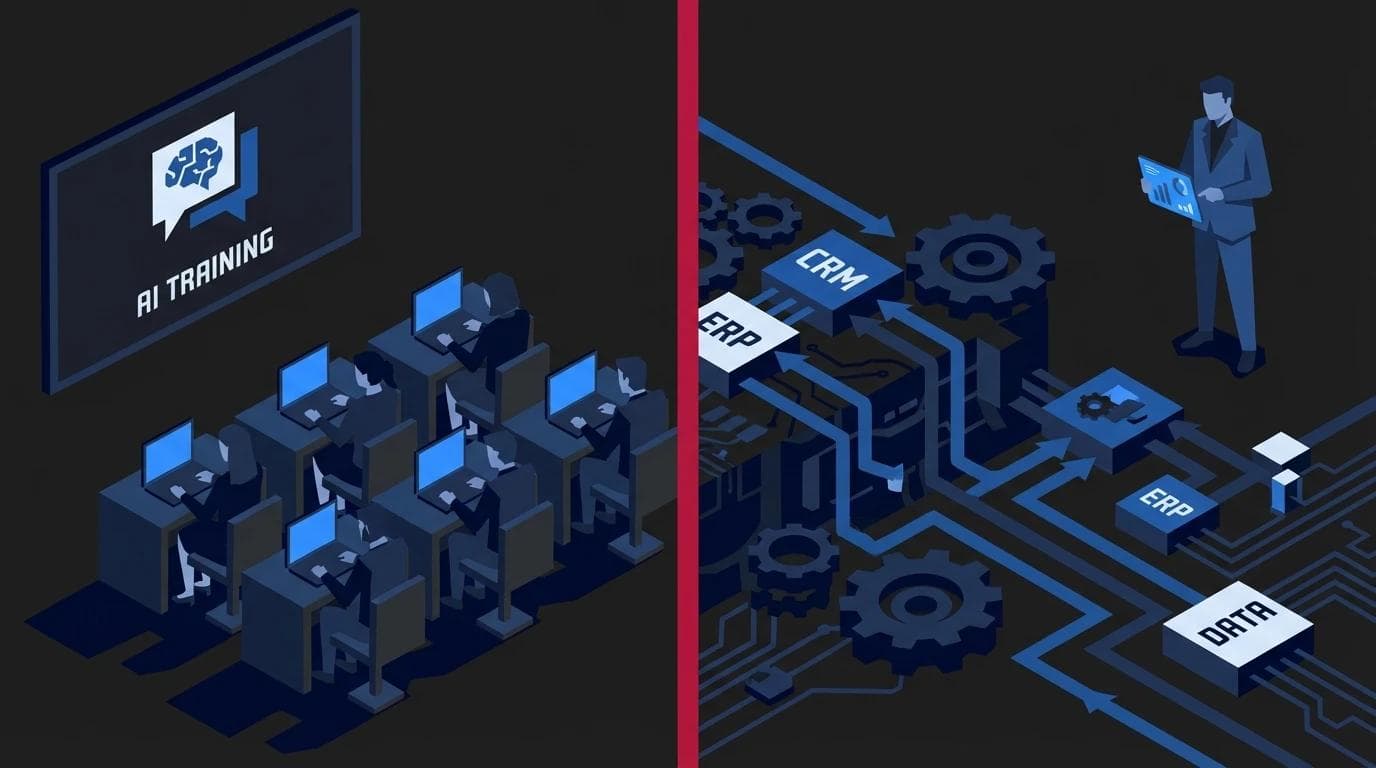

Szkolenia AI prawo oraz co każdy pracownik musi wiedzieć o unijnym AI Act

> Czym jest AI Act i jak unijne prawo wpływa na codzienne korzystanie z AI w pracy?

AI Act to pierwsze na świecie kompleksowe rozporządzenie regulujące rynek sztucznej inteligencji, które wprowadza jasne ramy prawne dla bezpiecznego i etycznego wykorzystania algorytmów w biznesie. Unijne prawo nakłada na organizacje obowiązek klasyfikacji narzędzi według poziomu ryzyka, wymuszając na zespołach świadome oraz odpowiedzialne operowanie danymi firmowymi. W praktyce oznacza to, że każde wdrożenie ai w firmie musi być poprzedzone audytem zgodności, aby uniknąć sankcji za stwarzanie zagrożeń dla użytkowników. Ignorowanie tych przepisów naraża przedsiębiorstwa na kary finansowe sięgające nawet 35 mln EUR, co stawia bezpieczeństwo ai w firmie na równi z wymogami znanymi z rozporządzenia RODO.

Zarządy nie mogą dłużej udawać, że nie widzą zjawiska Shadow AI, czyli sytuacji, w której pracownicy na własną rękę wprowadzają wrażliwe dane do publicznych generatorów treści czy kodu. Nowe regulacje zrzucają na firmy pełną odpowiedzialność za to, jakich algorytmów używają w celach komercyjnych. Profesjonalne szkolenia ai dla biznesu stają się zatem niezbędnym elementem mitygowania ryzyka prawnego i finansowego.

AI Act wprowadza rygorystyczną kategoryzację systemów, która bezpośrednio determinuje, jak można projektować automatyzacje procesów w strukturach organizacji:

- Systemy wysokiego ryzyka - obejmują rozwiązania wpływające na rekrutację, ocenę zdolności kredytowej czy zdrowie, wymagając pełnej dokumentacji technicznej i nadzoru ludzkiego.

- Systemy o ograniczonym ryzyku - narzędzia typu chatbot (np. ChatGPT), które muszą jasno informować użytkownika, że wchodzi w interakcję ze sztuczną inteligencją.

- Systemy o minimalnym ryzyku - proste filtry antyspamowe lub algorytmy w grach, które nie wymagają dodatkowych procedur audytowych.

Dla kadry zarządzającej kluczowe jest zrozumienie, że każdy członek zespołu powinien przejść merytoryczne szkolenia ai prawo, aby rozróżniać bezpieczne narzędzia od tych, które mogą naruszać własność intelektualną. Prawidłowo sformułowana strategia cyfryzacji musi dziś uwzględniać audyt posiadanych licencji oraz sposób trenowania modeli AI, na których opierają się wewnętrzne systemy firmy.

Wdrożenie zasad AI Act to nie tylko ochrona przed karami, ale przede wszystkim budowanie przewagi rynkowej opartej na etycznym wykorzystaniu technologii. Transparentność w korzystaniu z algorytmów buduje zaufanie klientów, szczególnie gdy wdrażane są zaawansowane aplikacje dedykowane zasilane firmowymi bazami danych. Zrozumienie unijnego prawa to fundament, na którym opiera się nowoczesna, bezpieczna i odpowiedzialna transformacja cyfrowa.

> Kluczowe wnioski dla zespołów korzystających z narzędzi AI

Zrozumienie regulacji prawnych to nie tylko kwestia unikania kar, ale przede wszystkim budowanie trwałej przewagi rynkowej opartej na zaufaniu i transparentności. Dla nowoczesnych zespołów operacyjnych najważniejszym wnioskiem jest fakt, że niewiedza nie zwalnia z odpowiedzialności - każda interakcja z algorytmem, od prostego zapytania po zaawansowaną analitykę, niesie ze sobą konkretne skutki prawne.

- Klasyfikacja ryzyka i zakazane praktyki - unijny AI Act wprowadza sztywne ramy dla systemów wysokiego ryzyka. Należy mieć świadomość, że użycie darmowego bota do oceny CV pracownika wkracza w sferę wysokiego ryzyka, co wymaga od firmy wdrożenia rygorystycznych mechanizmów kontrolnych. Niekontrolowane bezpieczeństwo ai w firmie może prowadzić do naruszeń ochrony danych osobowych, za które pełną odpowiedzialność ponosi organizacja.

- Obowiązek transparentności i oznaczanie treści - każdy pracownik musi wiedzieć, kiedy materiał tworzony dla klienta pochodzi od maszyny i wymaga stosownego oznaczenia. Zgodnie z przepisami, treści generowane przez AI muszą być identyfikowalne, aby odbiorca nie został wprowadzony w błąd. To fundamentalny element etyki, który wyjaśniają merytoryczne szkolenia ai dla biznesu, kładąc nacisk na bezpieczną komunikację zewnętrzną.

- Bezpieczeństwo infrastruktury i własność kodu - wdrażanie lokalnych, zamkniętych systemów na własnym serwerze drastycznie ogranicza obciążenia prawne dla firmy. W przeciwieństwie do publicznych narzędzi, gdzie dane mogą być wykorzystywane do uczenia modeli, aplikacje dedykowane gwarantują pełną izolację informacji. Wybierając szkolenia chatgpt dla biznesu, warto skupić się na rozwiązaniach Enterprise, które chronią własność intelektualną przed nieautoryzowanym użyciem.

- Edukacja jako narzędzie prewencji - AI Act nakłada na przedsiębiorców obowiązek zapewnienia odpowiedniego poziomu wiedzy pracownikom obsługującym systemy AI. Regularne szkolenia to nie tylko wzrost wydajności, ale przede wszystkim tarcza chroniąca przed błędami prawnymi. Kompleksowe szkolenia ai dla firm pozwalają zespołom zrozumieć mechanizmy działania algorytmów, co jest niezbędne do bezpiecznego wdrożenia automatyzacji procesów w codziennej pracy.

> Klasyfikacja systemów według AI Act - które narzędzia są bezpieczne w biurze?

Europejskie rozporządzenie o sztucznej inteligencji (AI Act) wprowadza hierarchiczną strukturę bezpieczeństwa, dzielącą technologię na cztery grupy ryzyka. W praktyce biurowej większość popularnych narzędzi, jak chatboty do pisania maili czy asystenci kodu, zalicza się do kategorii ryzyka minimalnego lub ograniczonego, co wymaga od firm głównie przejrzystości informacyjnej. Z kolei systemy wpływające na kluczowe aspekty życia, takie jak scoring kredytowy czy automatyczna selekcja CV w rekrutacji, są uznawane za rozwiązania wysokiego ryzyka (High Risk) i podlegają rygorystycznym wymogom nadzoru oraz dokumentacji.

Zrozumienie tej piramidy jest niezbędne, aby bezpieczeństwo ai w firmie nie stało się martwym zapisem, lecz realnym elementem strategii operacyjnej. AI Act wyróżnia następujące poziomy:

- Ryzyko niedopuszczalne - systemy całkowicie zakazane w Unii Europejskiej, takie jak techniki podprogowe manipulujące zachowaniem czy scoring społeczny prowadzony przez rządy.

- Wysokie ryzyko (High Risk) - to tu trafiają systemy służące do zarządzania infrastrukturą krytyczną, edukacją, a także narzędzia HR do wstępnej selekcji kandydatów oraz scoring kredytowy. Jeśli Twoja organizacja planuje wdrożyć aplikacje dedykowane w tych obszarach, musisz zapewnić potężną dokumentację techniczną, wysoką jakość danych i stały nadzór ludzki.

- Ograniczone ryzyko - dotyczy narzędzi takich jak chatboty (np. ChatGPT w standardowych zastosowaniach) czy generatory obrazów. Ich wdrożenie wiąże się głównie z obowiązkiem informowania użytkownika, że wchodzi w interakcję z algorytmem.

- Minimalne ryzyko - obejmuje większość filtrów spamu w poczcie, gry wideo czy proste skrypty pomocnicze. Te rozwiązania nie wymagają od przedsiębiorcy dodatkowych działań prawnych.

Dla managerów kluczowe jest rozróżnienie między prostym wsparciem w codziennych zadaniach a automatyzacją decyzji o dużym wpływie społecznym. Podczas gdy ogólne szkolenia ai dla firm skupiają się na wzroście produktywności, specjalistyczne szkolenia ai prawo muszą wyjaśniać różnice między wersjami darmowymi a rozwiązaniami klasy enterprise. Eksperci 01tech podkreślają, że wdrażając automatyzacje procesow, należy każdorazowo weryfikować, czy dany przepływ danych nie klasyfikuje się jako system wysokiego ryzyka. Wybierając merytoryczne szkolenia ai dla biznesu, Twój zespół zyska kompetencje niezbędne do budowania bezpiecznej i zgodnej z przepisami (Compliance) przewagi rynkowej.

> Dlaczego szkolenia AI prawo są niezbędne dla każdego pracownika?

Powszechny dostęp do modeli językowych sprawił, że każdy komputer w biurze stał się potencjalnym punktem wyjścia dla wrażliwych danych firmowych. Wiedza o przepisach to dzisiaj fundament, na którym opiera się bezpieczeństwo AI w firmie, ponieważ unijne rozporządzenie AI Act nakłada na organizacje konkretne obowiązki w zakresie przejrzystości i etyki. Nie jest to wyłącznie domena działu prawnego - Twoja firma jest tak bezpieczna, jak najsłabiej poinformowany pracownik. Jeśli ktoś z działu marketingu wygeneruje obraz za pomocą AI i opublikuje go jako „autentyczne zdjęcie” Waszego produktu bez stosownej adnotacji, naraża całą organizację na dotkliwą utratę wizerunku oraz konsekwencje prawne wynikające z wprowadzania konsumentów w błąd.

Edukacja w zakresie prawa to przede wszystkim ochrona własności intelektualnej i tajemnicy przedsiębiorstwa. Pracownicy muszą rozumieć, że niekontrolowane wklejanie fragmentów kodu źródłowego, poufnych raportów finansowych czy strategii sprzedażowych do publicznych czatbotów może skutkować ich bezpowrotnym wyciekiem do zbiorów treningowych dostawców technologii. Wybierając merytoryczne szkolenia AI dla biznesu, zyskujesz pewność, że zespół instynktownie będzie wiedział, gdzie przebiega granica bezpiecznego eksperymentowania. Pracownik świadomy prawnie potrafi odróżnić narzędzia o akceptowalnym ryzyku od tych, które mogą doprowadzić do naruszenia RODO lub praw autorskich osób trzecich.

Praktyczne szkolenia AI dla firm skupiają się na wypracowaniu wewnętrznych procedur (tzw. AI Policy), które regulują codzienną pracę. Obejmują one kluczowe aspekty, takie jak:

- Weryfikacja praw autorskich - zrozumienie, kto jest właścicielem treści wygenerowanych przez algorytmy i jak je bezpiecznie komercjalizować.

- Zarządzanie ryzykiem Shadow AI - eliminowanie nawyku korzystania z prywatnych kont w narzędziach AI do realizacji zadań służbowych.

- Oznaczanie treści syntetycznych - wypełnianie obowiązków informacyjnych wynikających z AI Act w komunikacji z klientem.

- Higiena danych osobowych - techniki anonimizacji zapytań wysyłanych do modeli zewnętrznych.

Inwestycja w kompetencje prawne to nie koszt, lecz tarcza ochronna. Zamiast blokować innowacje strachem przed karami, uczymy zespoły, jak korzystać z nowoczesnych rozwiązań w sposób odpowiedzialny. Dzięki temu automatyzacje procesów wdrażane w Twojej organizacji nie stają się bombą zegarową, lecz stabilnym narzędziem budowania przewagi rynkowej.

> Obowiązek transparentności - kiedy musisz poinformować, że treść stworzyła sztuczna inteligencja?

Transparentność w wykorzystaniu sztucznej inteligencji przestała być jedynie kwestią etyki, a stała się twardym wymogiem prawnym. Zgodnie z unijnym rozporządzeniem AI Act, użytkownicy systemów AI muszą być informowani o fakcie interakcji z algorytmem, szczególnie w przypadku deepfakes, generowania tekstów wpływających na opinię publiczną czy fotorealistycznych obrazów. Główne zasady szkolenia ai prawo kładą nacisk na to, by odbiorca nie został wprowadzony w błąd co do pochodzenia treści. Złota zasada w biznesie B2B jest prosta - nie oszukuj swojego partnera ani klienta. Budując profesjonalne automatyzacje procesów, musimy dbać o to, by każda interakcja z maszyną była jasno zasygnalizowana. Jeśli przykładowo uruchamiamy u klienta zaawansowanego bota wsparcia, który operuje na wewnętrznych procedurach firmowych, użytkownik musi na wstępie otrzymać komunikat: „Rozmawiasz z wirtualnym asystentem, czy chcesz przełączyć do operatora?”. Taka przejrzystość buduje zaufanie i pozwala uniknąć frustracji odbiorcy, co jest kluczowe, gdy analizujemy jak mierzyć roi ze szkoleń ai. Obowiązek oznaczania dotyczy również materiałów audiowizualnych. Jeśli Twoja firma generuje grafiki marketingowe przy użyciu Midjourney lub klony głosu do podcastów, prawo wymaga, aby takie treści posiadały metadane lub oznaczenia widoczne dla ludzkiego oka (np. znak wodny lub dopisek „AI-generated”). Brak takich oznaczeń naraża organizację na ryzyko shadow AI, o czym szerzej piszemy omawiając bezpieczeństwo ai w firmie. Zrozumienie tych zawiłości jest niezbędne dla każdego pracownika operacyjnego i managera. Dlatego profesjonalne szkolenia ai dla biznesu poświęcają znaczną część czasu na omówienie praktycznych aspektów prawnych i etycznych. Do najważniejszych obowiązków informacyjnych należą: Interakcja z botami - użytkownik musi wiedzieć, że rozmawia z maszyną, a nie z człowiekiem. Deepfakes i klony głosu - konieczność wyraźnego poinformowania, że obraz lub dźwięk został zmanipulowany cyfrowo. Teksty informacyjne - jeśli AI generuje treści dotyczące spraw publicznych lub ważnych decyzji konsumenckich, informacja o asyście algorytmu jest wymagana.

> Jak wdrożyć zasady AI Act w firmie bez blokowania innowacji?

Wdrożenie unijnego rozporządzenia o sztucznej inteligencji (AI Act) w organizacji nie musi oznaczać biurokratycznego paraliżu ani wstrzymania prac nad nowymi rozwiązaniami. Najskuteczniejszą strategią jest odejście od odruchowych zakazów na rzecz budowy bezpiecznej infrastruktury technicznej i jasnych ram prawnych. Firmy, które chcą zachować dynamikę wzrostu, powinny skupić się na stworzeniu Wewnętrznej Polityki AI, przeprowadzeniu audytu narzędzi oraz regularnym edukowaniu kadry zarządzającej i operacyjnej. Fundamentem jest zrozumienie, że bezpieczeństwo danych ai w firmie to nie koszt, lecz inwestycja chroniąca kapitał intelektualny przedsiębiorstwa.

Kluczem do sukcesu nie jest blokowanie postępu, ale przejęcie kontroli nad tak zwanym Shadow AI, czyli nieautoryzowanym użyciem darmowych narzędzi przez pracowników. Po przeprowadzeniu audytu warto wdrożyć w firmie bezpieczne kanały komunikacji z modelami językowymi. Jako inżynierowie rekomendujemy dostarczenie zespołom twardych narzędzi, takich jak piaskownice na własnym serwerze, gdzie pracownicy mogą operować legalnie na danych firmowych bez ryzyka ich wycieku do publicznych zbiorów treningowych. W takim modelu blokada dostępu do publicznych, darmowych czatów staje się naturalnym krokiem higienicznym, a nie ograniczeniem kreatywności. Często optymalnym wyjściem są aplikacje dedykowane, które projektujemy tak, aby spełniały wymogi regulacyjne już na poziomie architektury kodu.

Praktyczne kroki dla managerów obejmują:

- Audyt używanych narzędzi - identyfikacja wszystkich procesów, w których zespół wykorzystuje AI, i ocena ich ryzyka zgodnie z klasyfikacją AI Act.

- Wdrożenie bezpiecznej infrastruktury - zastąpienie publicznych wersji ChatGPT rozwiązaniami typu Enterprise lub API, które gwarantują prywatność danych.

- Szkolenia kompetencyjne - regularne szkolenia ai dla managerów pozwalają zrozumieć różnicę między bezpiecznym a ryzykownym wdrożeniem technologii.

- Automatyzacja procesów zgodności - wykorzystanie inteligentnych skryptów do monitorowania sposobu, w jaki AI przetwarza dane wewnątrz organizacji.

Wiele firm obawia się, że wymogi prawne spowolnią ich operacje. Tymczasem przemyślane szkolenia ai dla biznesu pokazują, że zrozumienie zasad AI Act pozwala na szybsze projektowanie stabilnych systemów. Zamiast budować na niepewnym gruncie, organizacja tworzy automatyzacje procesów, które są odporne na zmiany w przepisach. Warto również sprawdzić dostępne opcje finansowania takich działań - pomocny będzie nasz dofinansowanie na szkolenia ai przewodnik, który ułatwia pozyskanie środków na transformację cyfrową zgodną z nowym prawem. Kompleksowe podejście, łączące edukację z bezpieczną technologią, to jedyna droga, by wykorzystać pełen potencjał sztucznej inteligencji bez narażania firmy na wysokie kary finansowe przewidziane w rozporządzeniu.

> FAQ - najczęstsze pytania o szkolenia AI prawo i regulacje unijne

AI Act to rzeczywistość, która dotyka każdą polską firmę, niezależnie od jej wielkości. Jako inżynierowie z 01tech podkreślamy - małe i średnie przedsiębiorstwa (MŚP) również podlegają pod te przepisy, jeśli wdrażają lub udostępniają systemy AI na terenie Unii Europejskiej. Choć kary są miarkowane pod kątem obrotów, dla mniejszych podmiotów wciąż mogą oznaczać finansowy paraliż, dlatego profesjonalne szkolenia AI dla biznesu powinny dziś obejmować nie tylko sprawne promptowanie, ale przede wszystkim świadomość prawną i etyczną.

Czy AI Act zabrania używania darmowego ChatGPT w pracy?

Nie, AI Act nie wprowadza całkowitego zakazu korzystania z narzędzi takich jak darmowy ChatGPT, ale nakłada na firmy obowiązek rzetelnej oceny ryzyka i zapewnienia przejrzystości. Głównym problemem w tym przypadku jest tak zwane bezpieczeństwo AI w firmie, ponieważ publiczne wersje botów domyślnie wykorzystują wprowadzane dane do trenowania swoich modeli. Jeśli pracownik bez wiedzy zarządu wprowadzi do okna czatu raport finansowy lub dane osobowe klientów, firma naraża się na złamanie przepisów o ochronie danych osobowych oraz tajemnicy przedsiębiorstwa. Właśnie dlatego rzetelne szkolenia ChatGPT dla biznesu kładą tak duży nacisk na przejście na modele zamknięte lub korzystanie z bezpiecznych połączeń przez API.

Kto ponosi odpowiedzialność prawną za błędy wygenerowane przez AI?

Zgodnie z unijnymi regulacjami oraz polskim prawem pracy, odpowiedzialność za finalny efekt działania systemu AI spoczywa na wdrażającym (czyli pracodawcy), a nie na dostawcy samej technologii. Jeśli AI wygeneruje błąd w kodzie, który spowoduje straty, lub zaproponuje błędną strategię finansową, firma nie może zasłonić się halucynacją modelu. W relacji z pracownikiem kluczowy pozostaje nadzór ludzki (human-in-the-loop). Budując zaawansowane aplikacje dedykowane czy systemy oparte o inteligentne automatyzacje procesów, zawsze wdrażamy bezpieczniki wymagające ostatecznego zatwierdzenia wyników przez człowieka. Pracownik może ponosić odpowiedzialność dyscyplinarną tylko wtedy, gdy zignorował wewnętrzne procedury i regulaminy dotyczące pracy z narzędziami cyfrowymi.

Od kiedy przepisy AI Act stają się obowiązkowe dla polskich firm?

Przepisy AI Act weszły w życie w sierpniu 2024 roku, jednak ich pełne stosowanie jest rozłożone w czasie w formie okresów przejściowych. Najszybciej, bo już po 6 miesiącach, zaczęły obowiązywać zakazy dotyczące systemów o niedopuszczalnym ryzyku (np. scoring społeczny czy nieautoryzowane rozpoznawanie emocji). Większość standardowych obowiązków dla firm wdrażających szkolenia AI w biznesie wejdzie w pełni po 24 miesiącach. To vacatio legis to idealny czas na edukację i stworzenie polityki AI - nasz kompleksowy przewodnik po szkoleniach AI dla firm podkreśla, że budowanie kompetencji to proces ciągły. Firmy, które zaczną audytować swoje systemy i szkolić zespoły już dziś, nie tylko unikną kar, ale też zbudują kulturę innowacji opartą na bezpieczeństwie i pełnej własności technologicznej.